NVIDIA crea una división de NPU semicustom por 30.000 millones de $

NVIDIA tiene un pánico enorme Y es que muchos de sus potenciales clientes son empresas que han empezado el desarrollo de chips para IA de manera interna para no depender de la empresa de Jensen Huang. Lo que habría hecho que entren en pánico y hayan decidido crear una nueva división de NPU semicustom de NVIDIA.

Índice de contenidos

Tabla de contenidos

Las NPU semicustom de NVIDIA podrían ser una realidad

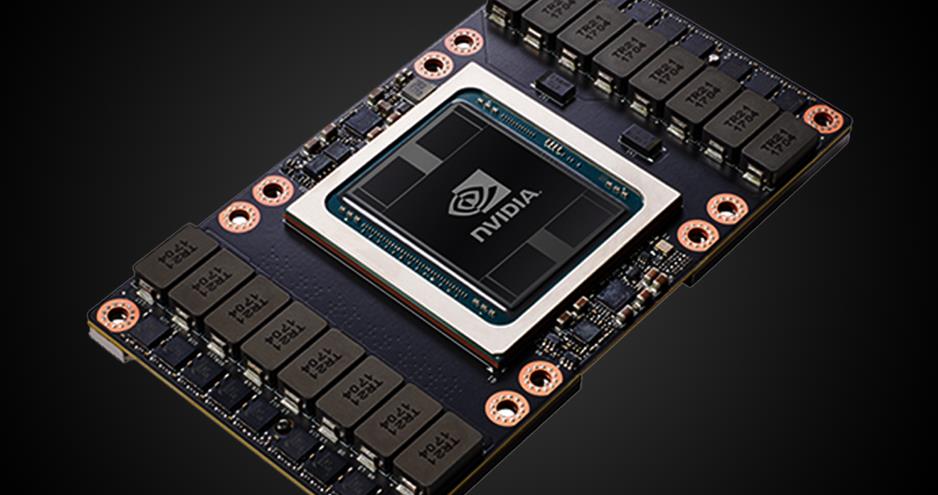

Es una paradoja el hecho que no exista una NPU de NVIDIA, pese a tener el 90% del mercado del hardware para IA, ya que todos sus productos orientados al Deep Learning y al Machine Learning son GPU con arrays sistólicos, Tensor Cores. No obstante, esto podría cambiar a corto plazo por la creación de una nueva división dentro del gigante verde, la cual se especializaría más en crear chips orientados exclusivamente a este segmento, pero en forma de soluciones a medida.

La nueva unidad, la cual según Reuters tiene un presupuesto de 30.000 millones de dólares, se encargaría de hacer chips a medida para grandes clientes. Muy parecido al negocio que tiene AMD con las consolas de videojuegos, donde utilizando tecnología ya existente, junto a nuevos bloques creados en exclusiva para ciertos clientes, terminan creando piezas únicas y totalmente personalizadas. Se dice que NVIDIA podría estar en charlas con empresas punteras en el mundo de la inteligencia artificial como: Microsoft, Meta, Google y OpenAI.

Por lo que se puede decir que en un futuro vamos a ver NPU semicustom de NVIDIA, algo que no nos esperábamos, debido a la estrecha integración entre IA, HPC y gráficos que ha habido hasta el momento.

La gran división: HPC versus IA

Para entender que hay detrás de la división de NPU semicustom de NVIDIA hemos de entender uno de los dilemas con los que los arquitectos de hardware se están enfrentando, especialmente los de NVIDIA y AMD; es que pronto van a tener que separar el desarrollo de los chips para computación de alto rendimiento de los pensados para Deep Learning y Machine Learning, algo que hasta el momento se ha mantenido homogéneo.

Sin embargo, no os extrañe en un futuro próximo ver cómo aparecen chips diferenciados.

- Las GPU orientadas a computación de alto rendimiento operan con números muy precisos, en coma flotante de doble precisión (64 bits).

- Mientras que las que están pensadas para el Deep Learning lo hacen con precisiones mucho más bajas de lo normal: FP16, BFLOAT16…

Esto provoca que los núcleos de las GPU como las H200 de NVIDIA o la AMD MI300 sean muy complejos, ya que reúnen un set de instrucciones muy complejo al tener que lidiar con dos mundos, por no hablar del exceso de unidades de ejecución. ¿La solución? Crear un núcleo especializado para IA y otro para computación de alto rendimiento, mucho más compactos y que permitan colocar mucho más núcleos, o mejor, dejar que sea el cliente el encargado de decidir lo que necesita para su sistema. Pues bien, esa es la filosofía detrás de las NPU semicustom de NVIDIA.