En los últimos días, ha aparecido un rumor falso acerca de la futura GB200 de NVIDIA, que ha hecho han hecho que uno se ponga las manos sobre la cabeza ante la enorme metida de pata de ciertos medios especializados. ¿El motivo? Confundirlo con el GB202, el chip más potente de las RTX 50, del cual esperamos ver su lanzamiento en 2025.

Índice de contenidos

Índice de contenidos

El chip GB200 de NVIDIA no es lo que muchos piensan

En los últimos días, hemos visto aparecer un rumor falso de la GB200 de NVIDIA, donde se dice que será una GPU perteneciente a la serie RTX 50 de NVIDIA con doble chip y la friolera de 384 SM, lo que equivalen a 49152 ALU en FP32. Una cifra que triplica a la de la actual RTX 4090, sin embargo, solo hay que ver la hoja de ruta de la compañía para los próximos años para ver a qué se refieren los de la marca verde con GB200 y si bien es un sistema MCM, no se trata de uno con doble GPU.

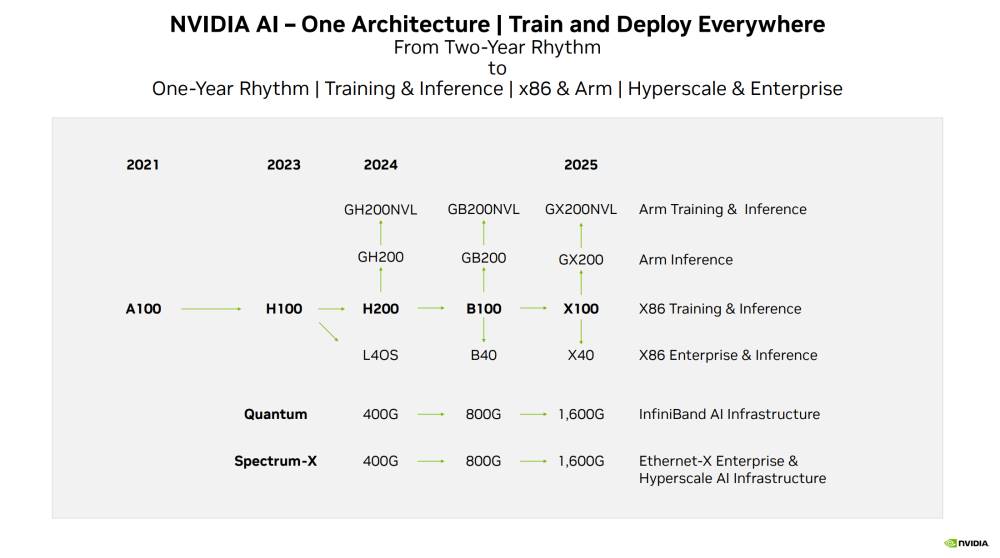

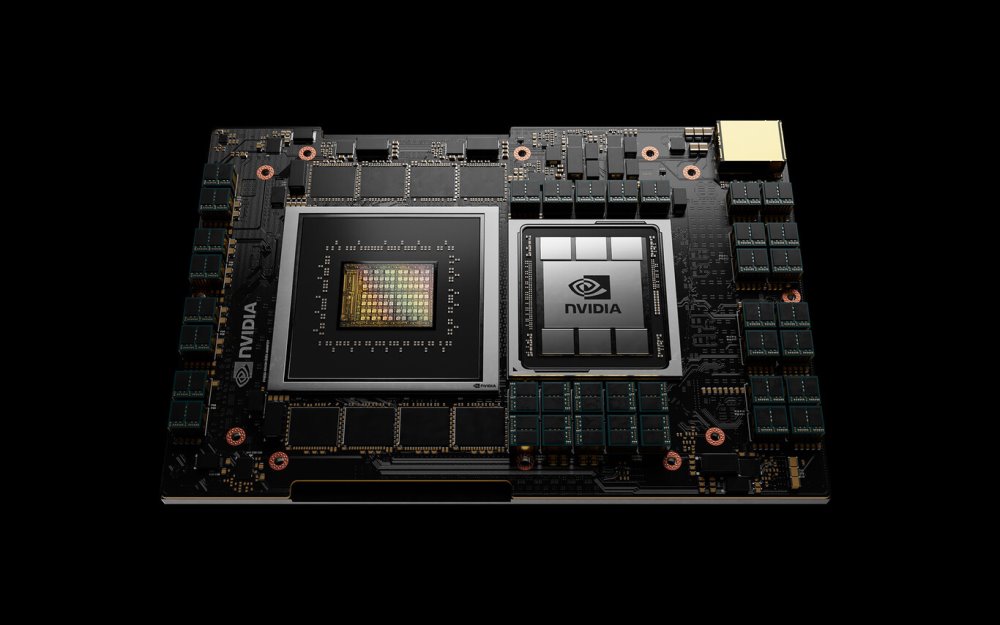

Cómo se puede ver en la hoja de ruta de NVIDIA tenemos tres arquitecturas, Hopper, Blackwell y una tercera de nombre en clave todavía desconocida, cuyo chip parece ser que será el X100 y que veremos en 2025. Justo un año después que el chip B100 que todavía es inédito. Fijaos además cómo tenemos al chip GB200 apuntado como ARM Inference. ¿Qué significa esto? Pues que estamos hablando de la evolución de NVIDIA Grace Hopper, que combina una CPU de decenas de núcleos H100 o H200 junto a una CPU de arquitectura Grace.

Es decir, en vez de tener un MCM con dos chips de GPU, lo que tenemos es una CPU y una GPU formando un sistema completo. Por lo que GB200 no es una doble GPU con 384 núcleos de doble chip. Es más, no sabemos que CPU usarán en dicha configuración. Es posible que continúen usando Grace para la próxima generación o al menos una versión mejorada del mismo, probablemente con más núcleos.

NVIDIA podría dar el salto a los chiplets con B100

Una de las cosas que ha puesto en alerta a NVIDIA es el hecho que la MI300X de AMD dispone de un total de 220 Compute Units frente a las 144 de su H200, por no hablar de los 192 GB de la opción de su rival frente a los 141 GB de la H200. La cantidad de memoria es importante en lo que a la escala de costes se refiere, ya que si esta tiene la suficiente capacidad, entonces un modelo de Deep o Machine Learning se puede ejecutar en una sola GPU, lo que hace al sistema más atractivo en cuanto a costes, pero al contrario de lo que ocurre en el mundo gaming, tener varios chips no es un problema.

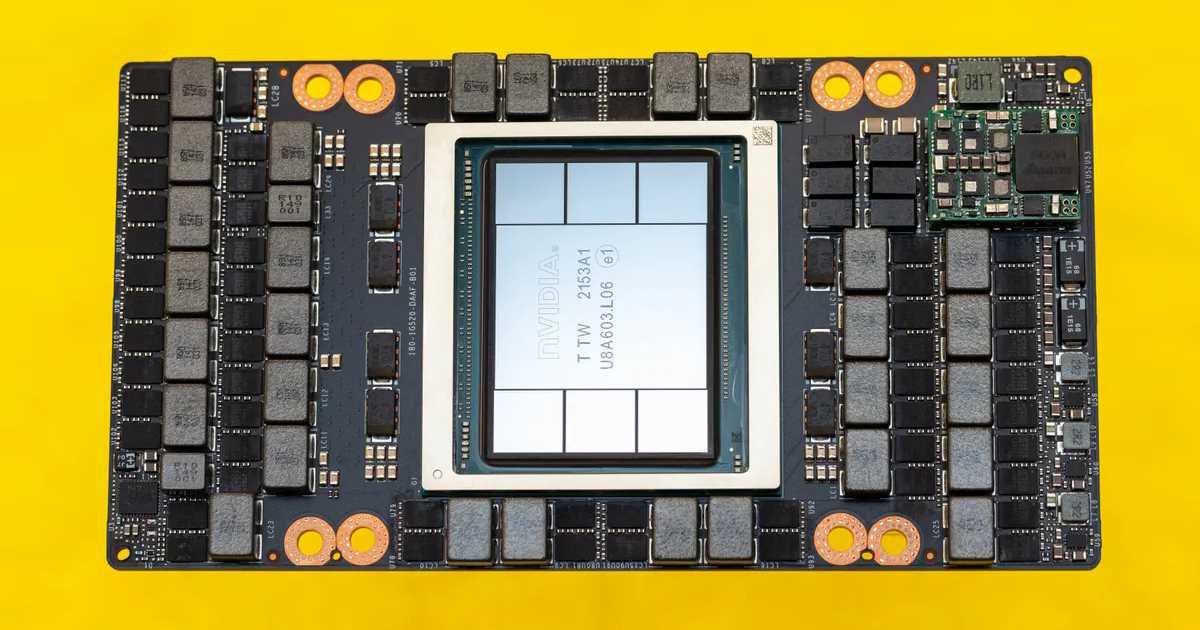

El problema es que actualmente NVIDIA con H100 y H200 ha llegado al límite de tamaño de un chip construido en un solo bloque, 858 mm² y si bien utilizarán el nodo de 3 nm de TSMC, lo que permitirá una mayor densidad en la lógica, hasta un 42%, hemos de partir que los cambios en lo que a la SRAM se refiere, usada en registros y caché son casi nulos. Por lo que no podrán escalar mucho en número de núcleos respecto a la H200 en GB200 si hablamos de un chip monolítico, y eso sin contar las mejoras arquitecturales que veremos.

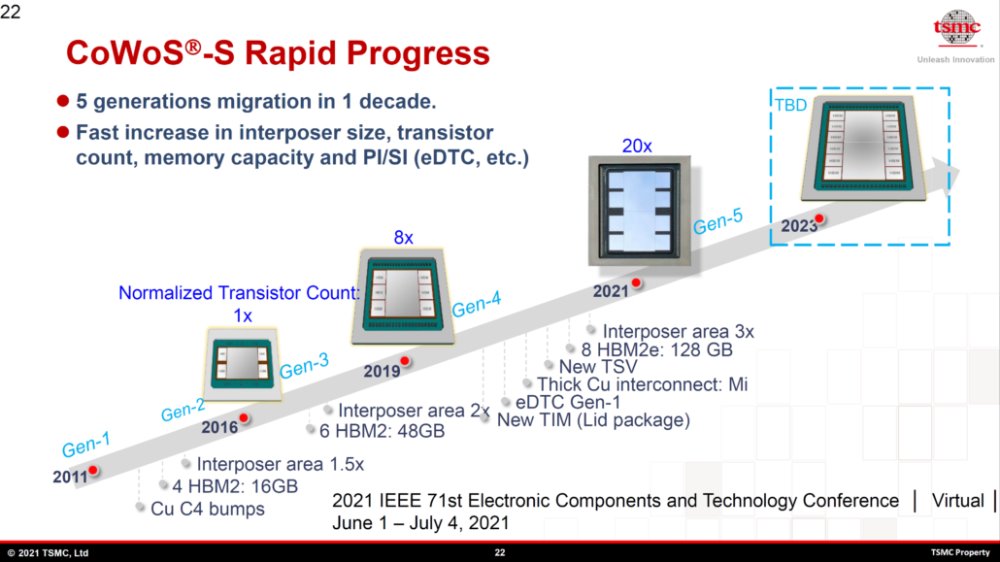

Sabemos por la hoja de ruta de TSMC que pueden fabricar GPU con configuraciones de 8 e incluso hasta 12 memorias HBM gracias a su tecnología CoWoS. ¿El problema con este tipo de configuración? El chip se ha de disgregar y hacerse por chiplets. Sin embargo, todo esto no son más que especulaciones, pero es la única manera de no verse limitados y poder alcanzar el rendimiento prometido.